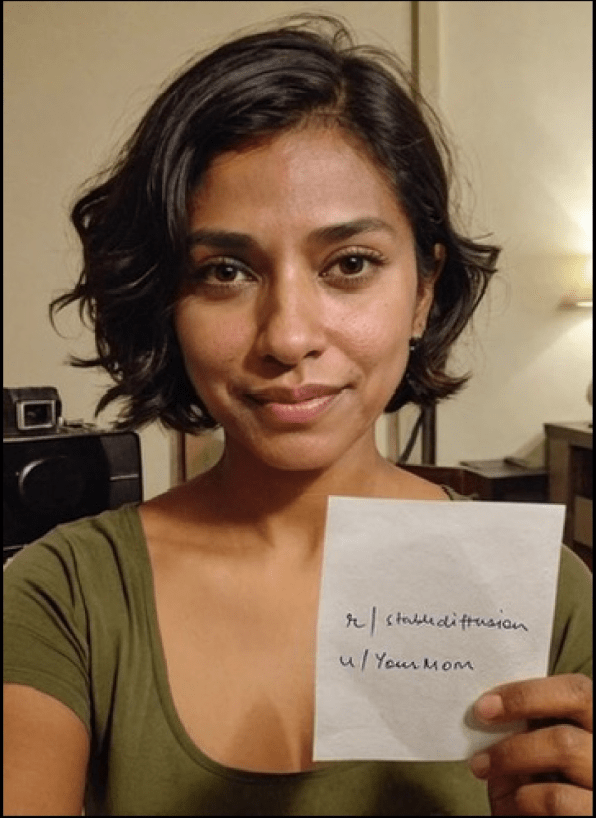

En un sorprendente desarrollo en el mundo de la ciberseguridad, el usuario de Reddit u/harsh ha generado imágenes utilizando Stable Diffusion que desafían las medidas de seguridad en el proceso de autenticación de identidad. En una de las imágenes, el individuo sostiene un papel con su nombre de usuario y el subreddit escrito a mano, mientras que en la otra sostiene un documento de identificación falso que coincide sorprendentemente con su rostro y detalles personales.

¿Por qué importa?

El proceso KYC, conocido como «know your customer», es vital para las instituciones financieras y bancos para verificar la identidad de sus clientes. La autenticación de imagen de identificación implica que los clientes carguen una foto de sí mismos sosteniendo un documento de identificación. Sin embargo, la introducción de la inteligencia artificial generativa (IA) trae consigo una amenaza más escalable que cualquier método anterior.

Aunque aún no se han registrado casos de engaño a sistemas KYC reales con imágenes generadas por IA, la facilidad con la que se pueden crear es motivo de alarma y plantea preocupaciones sobre la vulnerabilidad de estos sistemas.

¿Cómo lo hizo?

El creador, u/harsh, compartió su detallado flujo de trabajo, que implica el uso de varias LoRAs (Reglas de Ajuste de Lenguaje) para ajustar los modelos de IA antes de generar la imagen final. Además, se utilizó Photoshop para detalles como el texto escrito a mano y la modificación de datos en el documento de identificación.

El potencial de la IA en el robo de identidad, deepfakes y datos personales

En nuestras actividades en línea, dejamos una huella digital que puede ser explotada, ya sea por registros en sitios vulnerables o mediante la información que compartimos activamente. La IA ha avanzado al punto de crear simulaciones de voz y video en lo que conocemos como Deepfake.

Los ciberdelincuentes pueden utilizar esta tecnología para generar conversaciones de voz convincentes, como el caso de un ejecutivo británico que cayó en un fraude de 243,000 dólares debido a una llamada de voz generada por IA. Además, existe la amenaza de videos generados con imágenes nuestras intentando acceder a cuentas bancarias, superando los controles de KYC.

Estos desarrollos tecnológicos presentan nuevos desafíos a nivel investigativo, probatorio y jurídico-penal. La facilidad de acceso a estas tecnologías por parte del público general plantea la posibilidad de que cualquier persona sea víctima de usurpación de identidad mediante la IA. Es crucial que los juristas, las fuerzas del orden y los tribunales estén un paso por delante para prevenir y abordar los delitos derivados de estos avances técnicos. El panorama de la ciberseguridad evoluciona, y la sociedad debe adaptarse para enfrentar las amenazas emergentes.